North Star: una inteligencia artificial que busca prevenir guerras

La idea de que una máquina pueda anticipar una guerra suena a ciencia ficción. Sin embargo, eso es exactamente lo que propone «North Star«, una inteligencia artificial desarrollada por Arvid Bell, exprofesor de Harvard especializado en negociación y resolución de crisis. Este sistema pionero no se limita a recolectar datos, sino que crea sofisticadas simulaciones de escenarios geopolíticos, imitando las decisiones que podrían tomar los líderes del mundo ante situaciones críticas. Con la ayuda de modelos digitales llamados «gemelos de liderazgo», North Star busca anticipar los pasos que podrían desencadenar un conflicto armado y, más importante aún, detectar las oportunidades para evitarlo. Su objetivo no es espiar ni atacar, sino ayudar a evitar conflictos globales antes de que empiecen, funcionando como una suerte de sistema de alerta temprana al servicio de la diplomacia internacional.

¿Qué hace North Star?

Este sistema crea «gemelos digitales» de líderes mundiales: simulaciones que imitan su manera de pensar y reaccionar ante situaciones críticas. Imaginemos, por ejemplo, que simula a un presidente tomando decisiones con sueño acumulado o bajo presión militar. North Star analiza miles de escenarios como este al mismo tiempo.

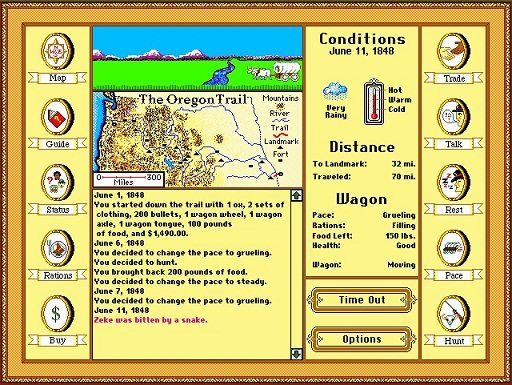

Incluso tiene una interfaz que recuerda al clásico videojuego de los años 70 «The Oregon Trail«, mostrando extensos textos que relatan los eventos del mundo simulado. Pero no es un juego: lo que está en juego es la paz mundial.

Un ejemplo concreto: Ucrania

En 2022, este sistema fue utilizado para simular qué pasaría si Estados Unidos imponía una zona de exclusión aérea en Ucrania. La IA predijo que habría un 60% de posibilidades de una escalada del conflicto por parte de Rusia. También generó un informe hipotético de inteligencia rusa, mostrando cómo podría reaccionar Moscú.

Más que predicciones: estrategias para la paz

North Star no solo anticipa problemas, sino que también sugiere cómo actuar: qué líderes podrían estar dispuestos a negociar y por qué vías hacerlo. Esta capacidad se basa en una comprensión profunda de patrones conductuales, condiciones personales (como la falta de sueño o el estrés), y el contexto político de cada figura simulada. Además, ofrece orientación estratégica que podría ser clave en negociaciones secretas o en la prevención de movimientos que puedan escalar tensiones. Es una herramienta pensada para diplomáticos, no para militares, diseñada con la filosofía de que la mejor guerra es la que se evita a tiempo.

Una nueva forma de ver la tecnología

Arvid Bell tiene una idea clara: «Los datos no inician guerras. Las personas sí«. Su meta es usar la tecnología como una alerta temprana que permita reaccionar con tiempo, algo que podría haber cambiado la historia en eventos como la Crisis de los Misiles en Cuba.

Críticas y desafíos del enfoque

Aunque North Star ha sido bien recibido por muchos sectores académicos y diplomáticos, también ha generado críticas importantes que vale la pena considerar.

Riesgo de consecuencias no deseadas

Algunos críticos argumentan que, aunque la intención de Bell es prevenir conflictos, el uso de inteligencia artificial para simular comportamientos de líderes mundiales podría tener el efecto contrario. Existe el temor de que estas simulaciones puedan ser malinterpretadas o utilizadas para justificar acciones agresivas, lo que podría escalar tensiones en lugar de mitigarlas. Por ejemplo, un analista señaló que, aunque Bell busca evitar guerras, su tecnología podría ser vista como una herramienta que, en manos equivocadas, podría desencadenar conflictos.

Dependencia excesiva en la tecnología

Otra preocupación frecuente es que confiar demasiado en herramientas como las desarrolladas por Anadyr Horizon pueda llevar a una deshumanización de la toma de decisiones. En contextos de crisis, la intuición, el juicio y la experiencia humana son insustituibles, y algunos temen que la tecnología termine por influir o incluso reemplazar estos procesos.

Complejidad y limitaciones de las simulaciones

A pesar de su sofisticación, hay quienes cuestionan si es posible modelar con precisión el comportamiento humano y las complejas dinámicas geopolíticas. Las decisiones de los líderes mundiales están influenciadas por emociones, creencias personales, ideologías e intereses internos difíciles de codificar en un algoritmo.

Ética y uso indebidos

Finalmente, surgen preguntas éticas. Si bien Bell ha insistido en el uso pacífico de su creación, algunos advierten que gobiernos o actores privados podrían utilizar estas simulaciones para obtener ventajas estratégicas o económicas, lo que podría agravar desigualdades o conflictos.

Vale la pena recordar esta frase de uno de mis activistas líderes, Julian Assange: «Si las guerras pueden iniciarse con mentiras, la paz puede iniciarse con la verdad«. Esta reflexión resuena con fuerza frente a herramientas como North Star, que prometen mayor transparencia y anticipación, pero también nos obligan a cuestionar los límites del control digital. Assange ha advertido sobre los riesgos de confiar en sistemas opacos y automatizados para tomar decisiones críticas. En ese sentido, si bien la tecnología puede ser aliada de la paz, también debe estar acompañada por una vigilancia ética y democrática que garantice su uso justo y responsable.

Por último,

Para quienes creemos que la tecnología puede mejorar el mundo, North Star representa también una esperanza concreta, no solo un ideal. Esta herramienta podría demostrar que la inteligencia artificial, bien dirigida, puede aportar soluciones reales a problemas humanos complejos como los conflictos internacionales. No se trata de controlar el futuro con predicciones infalibles, sino de comprender mejor las dinámicas del presente para anticiparse con sabiduría, empatía y visión estratégica.

Y lo más importante es que si usamos la tecnología con propósito, es posible construir un mundo más seguro para todos.

Y hoy, más que otras veces, recuerda que…

Yo soy Pablo, tu asistente tecnológico humano, como la IA, pero con «tracción a sangre»